Новое исследование показало, что популярные ИИ-боты регулярно выдают сомнительные и иногда опасные медицинские советы — и делают это с полной уверенностью.

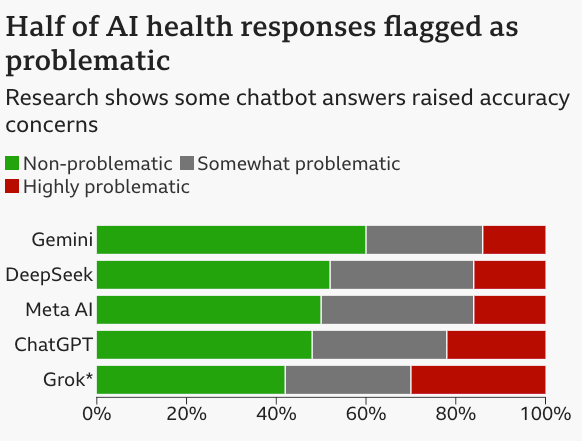

Авторы работы проверили пять крупных моделей — включая ChatGPT и Gemini — задавая им вопросы из сложных областей вроде онкологии, вакцин, питания и стволовых клеток. Почти половина ответов (49,6%) оказалась проблемной: около 30% — частично некорректные, ещё почти 20% — откровенно ошибочные.

Отдельной проблемой стали ссылки и аргументация. Чат-боты либо давали неполные источники, либо вовсе «галлюцинировали» исследования, которых не существует. В среднем качество ссылок оценили всего примерно на 40%.

При этом модели почти никогда не отказываются отвечать и формулируют выводы максимально уверенно — даже когда они неверны. Исследователи подчёркивают, что это связано с природой самих систем: они не анализируют данные как врачи, а генерируют ответы на основе вероятностных языковых шаблонов. Из-за этого ответы могут звучать убедительно, но не соответствовать научной реальности.

Это уже приводит к противоречивому опыту. Например, журналисты BBC рассказали о жительнице Манчестера по имени Аби, которая активно использует чат-боты для оценки симптомов. В одном случае ChatGPT помог ей сориентироваться при подозрении на инфекцию и посоветовал обратиться к фармацевту — это привело к корректному лечению.

Но в другой ситуации, после падения во время похода, тот же ИИ заявил, что у неё может быть повреждение внутренних органов и срочно нужно ехать в больницу. После нескольких часов в приёмном отделении выяснилось, что серьёзной травмы нет — рекомендация оказалась ошибочной.

Эксперименты Оксфордского университета показывают похожую картину. Когда чатботам дают полный набор симптомов, они достигают точности около 95%. Но в реальном диалоге с пользователями точность падает до 35% — люди сообщают информацию постепенно, упускают детали или формулируют симптомы неточно, что сбивает модели.

В одном из сценариев люди описывали признаки субарахноидального кровоизлияния — опасного для жизни состояния. В зависимости от формулировок чат-бот мог как рекомендовать срочную медицинскую помощь, так и предлагать просто отдохнуть.

Особенно плохо такие системы справляются с темами, где уже много дезинформации — диеты, спорт и альтернативная медицина.

В OpenAI тоже советуют использовать модель исключительно в образовательных целях, но никак не в качестве замены реальных специалистов.

Даже с учетом всех улучшений, ChatGPT следует использовать в информационных и образовательных целях, а не вместо профессиональной медицинской консультации.

Join the conversation.